IA Act & RGPD : 2026, l’année de vérité pour votre conformité ?

Adopté en août 2024, le Règlement européen sur l’intelligence artificielle (IA Act) marque un tournant pour toutes les organisations qui conçoivent, utilisent ou intègrent de l’intelligence artificielle.

Mais ses obligations les plus structurantes entrent en vigueur en 2026, au même moment où le RGPD continue de s’imposer comme le socle incontournable de la conformité numérique.

Pour la première fois, les organisations doivent gérer deux cadres réglementaires de grande envergure en même temps. Tour d’horizon de ce qui change, qui est concerné, et ce que votre organisation doit faire.

L’IA Act en bref

L’IA Act (UE 2024/1689) est entré en vigueur le 1er août 2024. Il s’applique à toute organisation européenne, ou opérant dans l’UE, qui conçoit, déploie ou met sur le marché des systèmes d’intelligence artificielle.

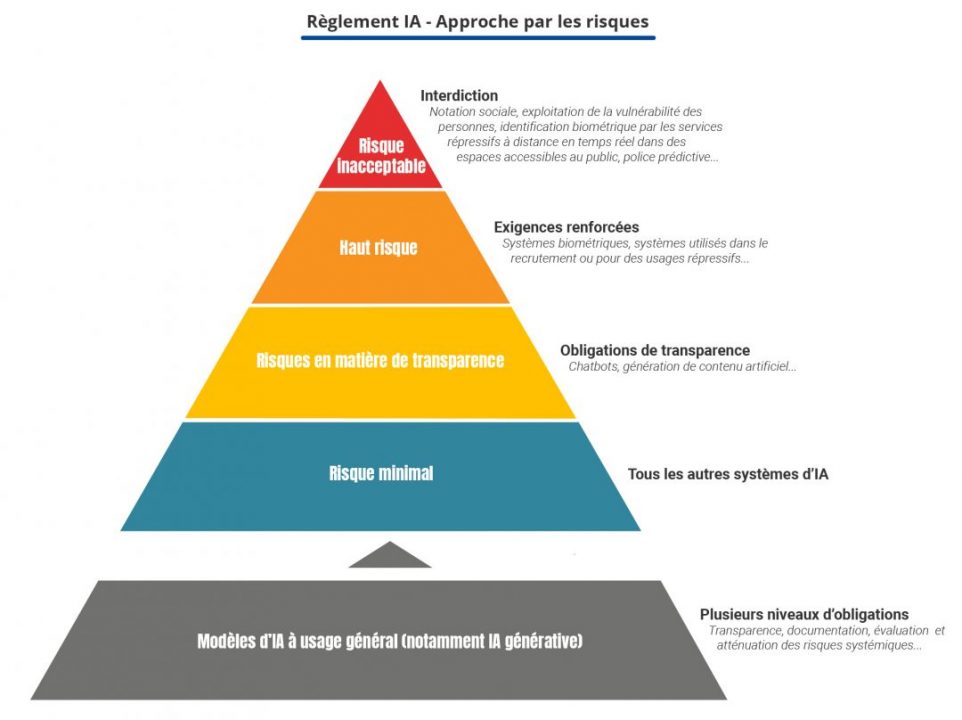

Ce règlement repose sur une logique fondée sur le niveau de risque :

- Risque inacceptable : systèmes formellement interdits (manipulation cognitive, scoring social, reconnaissance biométrique de masse en temps réel dans l’espace public).

- Risque élevé : systèmes strictement encadrés dans des domaines sensibles — emploi, santé, justice, sécurité, éducation, accès au crédit.

- Risque limité : obligations d’information allégées. L’utilisateur doit savoir qu’il interagit avec une IA.

- Risque minimal : usage libre, sans obligations spécifiques.

| La difficulté pour les organisations : déterminer dans quelle catégorie tombent leurs propres outils. Un outil de scoring RH développé en interne ? Un chatbot qui oriente vers des prestations sociales ? La frontière entre risque limité et haut risque n’est pas toujours évidente. |

Un calendrier serré

2 février 2025 : interdiction des pratiques à risque inacceptable

Certaines technologies sont désormais formellement interdites, notamment :

- La reconnaissance émotionnelle en entreprise et dans les établissements d’enseignement.

- Le scoring social basé sur le comportement des personnes.

- L’analyse biométrique à grande échelle sans consentement dans les espaces publics.

Toute organisation utilisant encore ces systèmes s’expose d’ores et déjà à de lourdes sanctions.

2 août 2025 : début de l’application des sanctions

À partir de cette date, les autorités nationales de surveillance peuvent infliger des amendes en cas de non-respect du règlement, y compris pour :

- Absence de documentation ou d’analyse d’impact pour les IA à haut risque.

- Non-respect des obligations de transparence pour les IA génératives (assistants, modèles fondationnels…).

- Usage de systèmes IA sans conformité aux exigences applicables.

Août 2026 : application complète pour tous les systèmes à haut risque

C’est l’échéance critique. Toutes les organisations déployant des systèmes à haut risque devront être pleinement conformes : gestion documentée des risques, qualité des données, transparence, supervision humaine, journalisation des décisions.

2027 : entrée en vigueur progressive pour les modèles GPAI

Les modèles d’IA à usage général (grands modèles de langage, modèles d’image…) bénéficient d’une période transitoire supplémentaire. Leurs fournisseurs devront notamment fournir une documentation technique complète, évaluer et limiter les risques systémiques, et étiqueter clairement les contenus générés comme artificiels.

| À retenir : les sanctions sont applicables depuis août 2025. Le fait de ne pas encore déployer un système à haut risque ne dispense pas d’une veille active et d’une préparation documentée. |

Qui est concerné par l’IA Act ?

Toutes les organisations impliquées dans l’IA, directement ou indirectement :

- Fournisseurs : éditeurs, développeurs, laboratoires qui conçoivent les systèmes IA.

- Déployeurs : utilisateurs professionnels qui intègrent ou utilisent ces systèmes dans leur activité.

- Distributeurs et importateurs : intermédiaires qui mettent ces systèmes sur le marché européen.

Point important : même les organisations qui achètent des outils tiers intégrant de l’IA peuvent être co-responsables de leur conformité. Acheter un logiciel RH avec un module de scoring algorithmique ne dégage pas l’acheteur de ses obligations en tant que déployeur.

IA ACT et RGPD indissociable ?

L’IA Act ne remplace pas le RGPD : les deux règlements s’appliquent conjointement. Toute organisation devra s’assurer que ses systèmes IA respectent à la fois les règles de sécurité, de loyauté et de transparence du RGPD, et les obligations techniques et organisationnelles de l’IA Act.

Là où les deux textes convergent

La qualité des données. Le RGPD impose exactitude et minimisation. L’IA Act impose des données d’entraînement représentatives et non biaisées. Un système IA entraîné sur des données défaillantes est doublement non conforme.

La transparence et la supervision humaine. L’article 22 du RGPD prévoit le droit à ne pas faire l’objet d’une décision purement automatisée. L’IA Act impose que les systèmes à haut risque soient suffisamment explicables et supervisés. Ces deux exigences convergent vers une même réalité : l’humain doit rester dans la boucle décisionnelle.

La sécurité. Le RGPD impose des mesures de sécurité appropriées (article 32). L’IA Act exige robustesse et résistance aux manipulations. Ces deux cadres se complètent pour garantir la sécurité des systèmes qui traitent des données personnelles.

Là où des tensions existent

Minimisation vs. données d’entraînement. Le RGPD demande de ne collecter que ce qui est strictement nécessaire. L’IA Act demande des jeux de données larges et diversifiés pour les systèmes à haut risque. Cette tension doit être gérée via une AIPD (Analyse d’Impact sur la Protection des Données) solide et documentée.

Conservation des données. L’IA Act impose de conserver la documentation technique pendant 10 ans. Le RGPD impose de ne pas conserver les données personnelles au-delà du nécessaire. Il faut distinguer soigneusement les deux — et le formaliser dans vos politiques internes.

| Règle pratique : toute nouvelle implémentation d’un système IA doit désormais faire l’objet d’une AIPD menée conjointement avec une évaluation du niveau de risque IA Act. Ces deux exercices sont indissociables. |

Ce que votre organisation doit faire concrètement

Voici les 6 actions essentielles à engager dès maintenant :

1. Identifier tous les systèmes IA utilisés ou en projet dans votre organisation, y compris les outils SaaS tiers intégrant de l’IA.

2. Évaluer leur niveau de risque selon la classification de l’IA Act — en portant une attention particulière aux outils RH, de crédit, de santé ou de sécurité.

3. Écarter ou remplacer toute IA relevant des pratiques interdites depuis février 2025.

4. Mettre en conformité les IA à haut risque : documentation, analyse d’impact, supervision humaine, journalisation.

5. Former les équipes et désigner des référents IA en interne. L’article 4 de l’IA Act impose une exigence explicite de culture IA au sein des organisations.

6. Vérifier la conformité des fournisseurs et sous-traitants IA : mettre à jour les contrats pour inclure vos droits d’audit et d’information.

Ces actions s’inscrivent dans la continuité d’une démarche RGPD déjà structurée : le registre des traitements, les AIPD, la gouvernance des données sont des fondations directement réutilisables. Une organisation mature sur le RGPD a une vraie longueur d’avance.

Les sanctions encourues

Le règlement prévoit un régime de sanctions graduées, comparable dans sa logique au RGPD :

| Type d’infraction | Amende maximale |

| Usage d’un système d’IA interdit | 35 M€ ou 7 % du CA mondial |

| Non-conformité aux obligations « haut risque » | 15 M€ ou 3 % du CA mondial |

| Informations trompeuses transmises aux autorités | 7,5 M€ ou 1 % du CA mondial |

Ces sanctions s’ajoutent à celles du RGPD, elles ne se substituent pas. En cas de manquement simultané aux deux règlements, les amendes sont cumulables. Les autorités nationales chargées de la surveillance de l’IA Act sont en cours de désignation dans les États membres.

Contrairement aux premières années du RGPD, les pouvoirs publics européens ont clairement exprimé leur intention d’appliquer ce texte sans délai de grâce prolongé.

Envie d’aller plus loin ?

Notre rôle n’est pas d’alarmer, mais de vous aider à naviguer dans un environnement réglementaire qui se complexifie.

Chez Actecil, nous vous accompagnons concrètement pour :

- identifier vos systèmes IA,

- évaluer leur niveau de risque,

- intégrer les exigences IA Act dans votre registre et vos AIPD,

- et former vos équipes sur les obligations combinées RGPD / IA Act.

Une formation spécialement dédié sur l’IA et le RGPD est déjà disponible.

Besoin de mettre en conformité vos pratiques ? : contactez-nous

Articles similaires